DeepSeek服务器繁忙的终极解决方案:满血平替、本地部署攻略

最近 DeepSeek 有多火爆就不多说了。热度蹭蹭地往上涨!

不过,也正因如此,导致很多人想用而用不上。

经常是 DeepSeek「服务器繁忙,请稍后再试」的提示,严重影响大家使用!

有的时候是这样的:

为了解决这个问题,我来分享下"在线使用DeepSeek"的两种方法。

许多读者都说很实用,解决了燃眉之急。

一、DeepSeek R1 满血平替

AI智慧岛:https://chat.yixiaai.com 支持 DeepSeep R1满血版、V3.1最终版、V3.2-Exp模型~

秘塔 AI:https://metaso.cn/

纳米 AI:https://www.n.cn/

国家超算互联网:https://chat.scnet.cn/

二、本地部署攻略

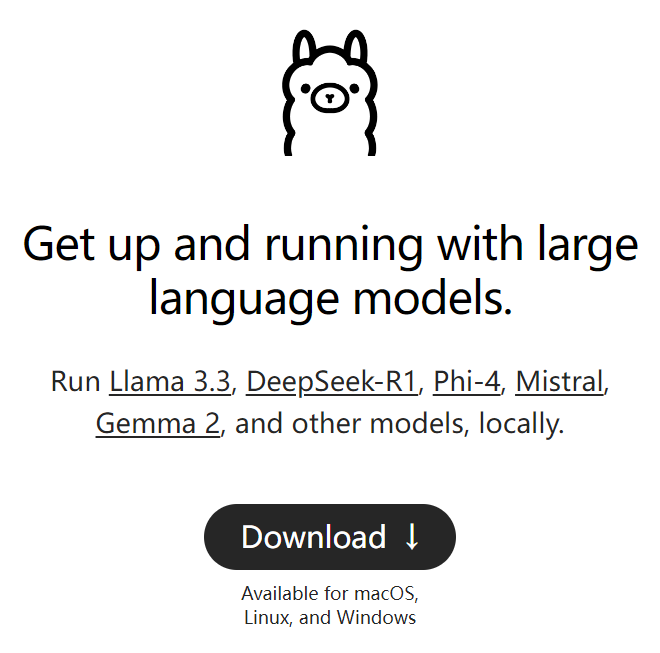

推荐使用 Ollama 工具进行本地部署。Ollama不仅支持 DeepSeek,还可以运行其他多种AI模型~

1. 下载 Ollama

首先访问 Ollama官方网站,根据你电脑的系统,下载对应版本的 Ollama,然后安装即可。

Ollama是一个用于本地运行和管理 AI 模型的工具,用于与各种模型进行交互。

你也可以在电脑上看到 Ollama 的图标,双击打开即可。

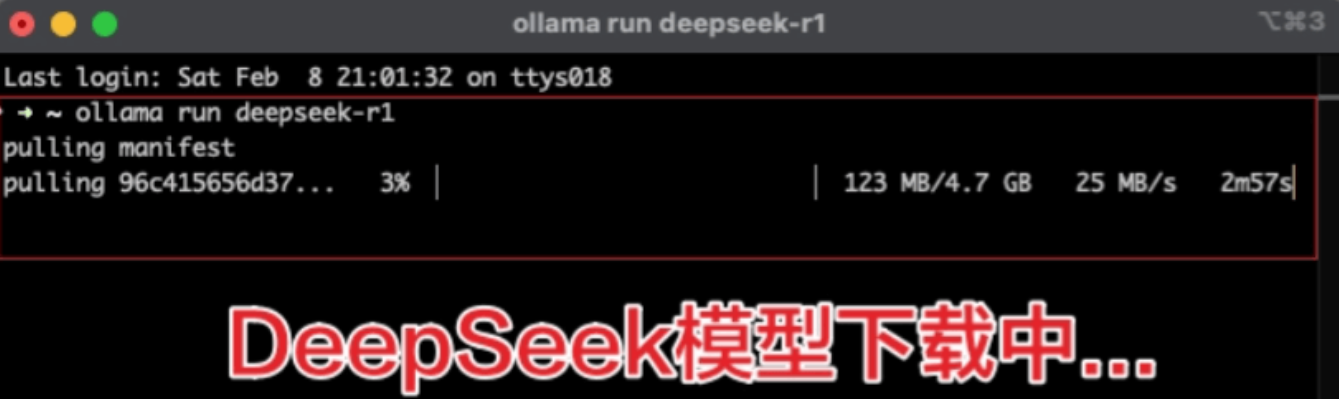

2. 下载 DeepSeek R1 模型

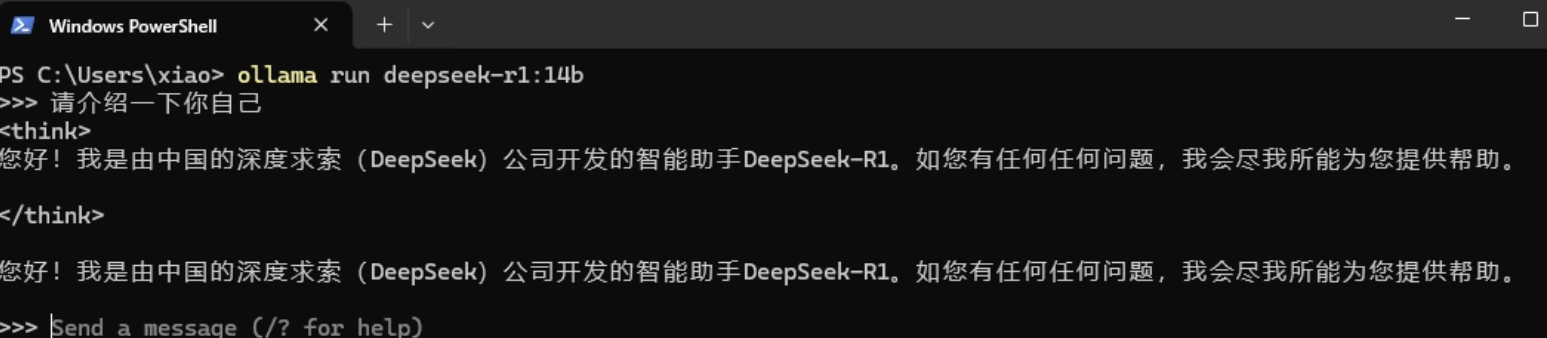

接下来需要打开电脑的终端命令行工具,输入命令 ollama run deepseek-r1:32b,后面的是模型尺寸,32b 是 320 亿参数的模型。

接着就可以正常下载 DeepSeek R1模型了

3. 运行模型

输入命令 ollama run deepseek-r1:32b,然后回车,即可运行模型。

4. 常用命令

整理一些常用 Ollama 命令,使用时将 {model_name} 替换成具体模型名称

- 安装模型:ollama pull

- 运行模型:ollama run

- 删除模型:ollama rm

- 列出已安装模型:ollama list

三、总结

以上就是解决 DeepSeek 服务器繁忙问题的两种方法。

如果觉得有用,可以分享给身边有需要的朋友~